Armas para a guerra entre artistas x IA (do lado dos artistas)

Com o crescimento e aumento da acessibilidade à ferramentas de inteligência artificial (IA) generativa, muito se fala sobre profissões e serviços serem substituídos por IA. Uma das áreas que mais preocupa é a de artes visuais. Enquanto muitas pessoas se encantam com o "poder" dos modelos de geração de imagens, desenhistas, cartunistas, designers, pintores e muitos outros profissionais dessa área podem se sentir ameaçados pelo advento da tal da IA generativa. Com isso, é importante saber que já existem esforços para permitir que artistas que publicam seu trabalho na internet possam proteger sua arte de ser utilizada em treinamento de modelos de IA.

A verdade é que sem dados para treinamento, ou seja, imagens produzidas por terceiros, os modelos de geração de imagens não seriam capazes de gerar nada. O que ocorre é que os modelos de IA generativa se apropriam da arte e padrões que um artista produz, ou seja, dependem deles. Os modelos são treinados com uma quantidade massiva de imagens, geralmente obtidas da internet, incluindo produções de artistas famosos e amadores, geralmente sem o consentimento deles, mas o que poucos sabem é que já existem meios de artistas evitarem que sua arte alimente modelos de IA generativa.

O Nightshade e o Glaze são duas ferramentas desenvolvidas por pesquisadores da Universidade de Chicago. Ambos fazem alterações invisíveis nas imagens, alteram pixels estrategicamente de forma que não percebemos visualmente mas podem confundir (ou "envenenar") o treinamento de um modelo geração de imagens fazendo com que o modelo não consiga correlacionar corretamente os padrões existentes em conjunto de imagens.

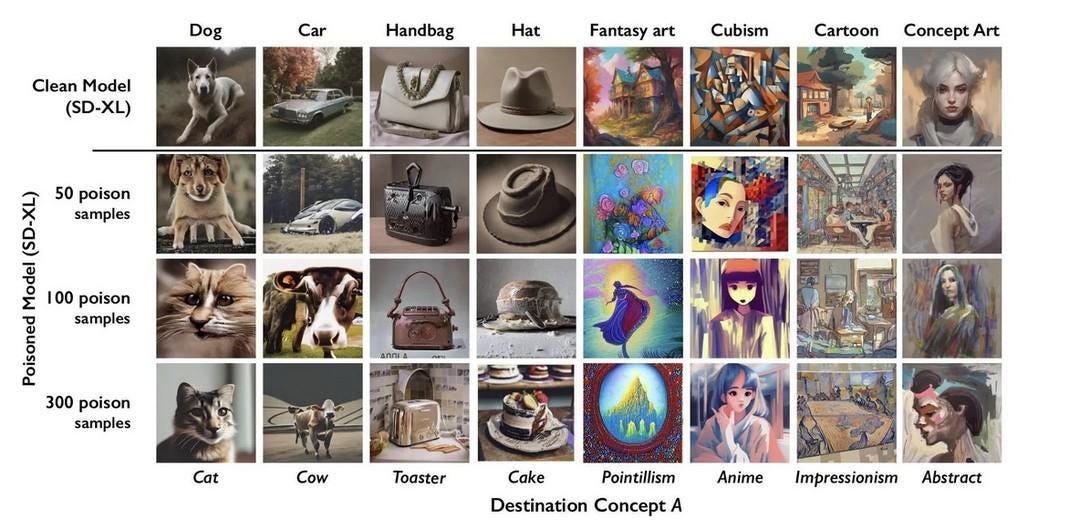

O Glaze permite o artista mascarar o seu estilo pessoal, sua identidade artística. Já o Nightshade atua como uma defesa ofensiva, ele pode confundir o treinamento fazendo, por exemplo, com que o modelo gere imagens de gatos quando é solicitado cachorros, ou vacas quando solicitado carros.

Em testes usando alguns modelos de terceiros e um próprio, os pesquisadores perceberam que com 50 imagens alteradas dentre a base de treino, os resultados do modelo já começavam a ter distorções, e com cerca de 300 imagens, o modelo já retornava resultados confusos.

Reprodução: artigo no MIT Technology Review. Imagem fornecida pelos autores

É claro que, para modelos mais poderosos é necessário mais imagens envenenadas dentre as bases de treino, já que são treinados com bilhões de imagens. Mas para as empresas de IA, é um problema complicado de resolver, pois não é trivial identificar se uma imagem é envenenada ou não e muito mapear uma base com bilhões de imagens.

Algumas empresas de IA já oferecem a alternativa para usuários escolherem permitir ou não que seus trabalhos compartilhados na internet sejam usados para treinar modelos de IA. Mas para muitos artistas, isso ainda não é o suficiente. E estão certos, já que não existe um controle centralizado sobre quem utiliza o conteúdo disponível na grande rede global.

Com ferramentas como o Nightshade e Glaze, o artista tem algum poder sobre o próprio trabalho e pode protestar e barganhar pelo respeito aos seus direitos autorais. Mas só haveria um impacto maior nesse conflito entre artistas e empresas de IA generativa se, uma grande maioria dos artistas passasse a publicar conteúdo envenenado nas redes.

Esse texto foi gerado a partir de uma postagem que fiz no Threads em Novembro de 2024.

Referências

- Site do Nightshade (e Glaze): https://nightshade.cs.uchicago.edu/whatis.html

- Artigo no MIT Technology Review sobre as ferramentas: https://www.technologyreview.com/2023/10/23/1082189/data-poisoning-artists-fight-generative-ai/

- Pre-print do Nightshade: https://arxiv.org/abs/2310.13828